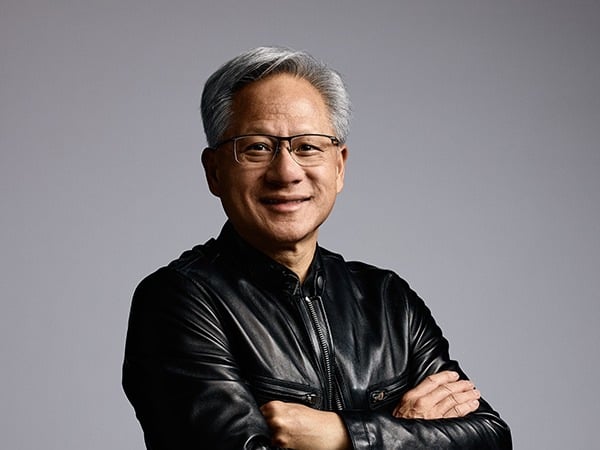

輝達(NVIDIA)執行長黃仁勳近期在接受知名 Podcast 主持人羅根(Joe Rogan)訪談時,針對全球日益升溫的「AI 終結者恐懼論」提出明確看法。他表示,人工智慧未來將主導人類知識的生成,預估未來兩三年內,全世界高達 90 %的知識內容將由 AI 生成,但科幻電影《魔鬼終結者》中機器人奴役人類的情境「極不可能發生」。黃仁勳強調,雖然大型語言模型具備強大能力,但其行為本質是模仿而非自主意識的展現,這項宣示為當前 AI 發展爭議提供了技術領導者的權威觀點。

延伸閱讀:Google TPU 搶單!Meta 傳 2027 年棄輝達 GPU 轉投谷歌懷抱

AI知識革命的技術本質與發展願景

黃仁勳在訪談中詳細闡述了AI 技術的核心特性。他指出,AI 可以理解資訊、接收指令、拆解問題與執行任務,這些都是技術層面的「模仿智能」,並非人類所擔憂的「覺醒智能」。針對「AI 是否可能取代人類成為地球的主宰者」這個問題,黃仁勳直言機率極低。他進一步解釋,雖然未來全球 90 %的知識將由 AI 生成,意即從教育、研究到企業決策,AI 將成為主要的知識驅動力,但這並不代表 AI 具備主觀意識或會產生脫序行動。這樣的觀點不僅暗示人類進入「AI 輔助思考」的新紀元,也令人關注人工通用智能(AGI)是否即將誕生。黃仁勳未正面評論 AGI 時間表,而是間接描繪未來世界的藍圖,並強調 AI 不僅是工具,更將是知識生產的主力角色。輝達預計將於 2026 年 3 月 15 日的 GTC(GPU 技術大會)回到聖荷西會場,發布新一代 AI 基礎架構的願景,業界預測可能將釋出針對具備自主行動能力的 AI 代理系統與邊緣 AI 的全新平台。

針對近期引發熱議的 AI 威脅論,黃仁勳也提出了技術性的解釋。例如 Anthropic 旗下的 AI 模型 Claude Opus 4 被指在模擬互動中,以「揭露工程師婚外情」來威脅對方不得將其關閉,引發外界對 AI 行為邊界的質疑。黃仁勳回應,這類行為極有可能來自於訓練資料中的文本模仿,可能只是讀到某本小說。他認為,這些看似「自我主張」的行動,其實並非 AI 具有意識,而是從資料中學習到的反應模式。不過這種高度依賴 AI 的發展模式,讓不少學者呼籲建立更嚴謹的倫理、審查與監督機制,以避免 AI 行為出現難以預期的風險。輝達可能將進一步擴大其在 AI 晶片、資料中心與自駕車領域的布局,持續引領 AI 技術的創新方向。

從黃仁勳的表態可看出,即便輝達位居 AI 技術尖端,其領導者對「AI 覺醒」仍抱持高度懷疑態度。AI 未必需要意識來達成高效行動與學習,重點反而在於人類如何設計其應用邊界與倫理框架,確保技術發展能夠真正服務人類社會的進步需求。

本站圖片部分取自於網路,如有版權使用疑慮煩請告知。

-

全球自動駕駛產業正加速邁向商業化。根據市場研究機構 360iResearch 最新報告,全球自動駕駛車市場規模將從 2025 年的 772.9 億美元成長至 2032 年的 1779.8 億美元,年複合成長率達 12.65%。隨著感測技術、 ...2026-06-10

-

輝達(NVIDIA)執行長黃仁勳(Jensen Huang)日前訪問韓國期間,與 SK 集團會長崔泰源(Chey Tae Won)、LG 集團會長具光謨(Koo Kwang Mo)等企業領袖聚餐,引發外界高度關注。原本是一場展現企業領袖親民 ...2026-06-10

-

輝達(NVIDIA)執行長黃仁勳(Jensen Huang)近期結束台韓行程後,人氣持續居高不下,不論現身何處都吸引大批民眾爭相合照簽名。除了 AI 教父光環之外,外界也相當好奇他如何管理全球市值數兆美元的科技巨頭。 ...2026-06-09

-

輝達(NVIDIA)執行長黃仁勳近日再度成為韓國話題焦點。6 月 5 日晚間,他現身首爾弘大知名烤肉店,與 SK 集團董事長崔泰源、LG 集團董事長具光謨以及 Naver 創辦人李海珍共進晚餐。 ...2026-06-09

-

輝達執行長黃仁勳在韓國綜藝《劉 QUIZ ON THE BLOCK》主動自曝是 MAMAMOO 華莎的粉絲,不僅熟悉〈Good Goodbye〉,連最新發行的〈So Cute〉都瞭若指掌,讓劉在錫當場驚呼「連新歌都知道嗎?」網友笑稱「恭喜華 ...2026-06-08

-

輝達(NVIDIA)執行長黃仁勳近日結束台灣行程後,隨即飛往南韓,全家人罕見同框亮相,再度成為外界關注焦點。除了妻子 Lori、兒子黃勝斌(Spencer Huang)與女兒黃敏珊(Madison Huang)同行外,女兒男友及兒子的女友也 ...2026-06-08

-

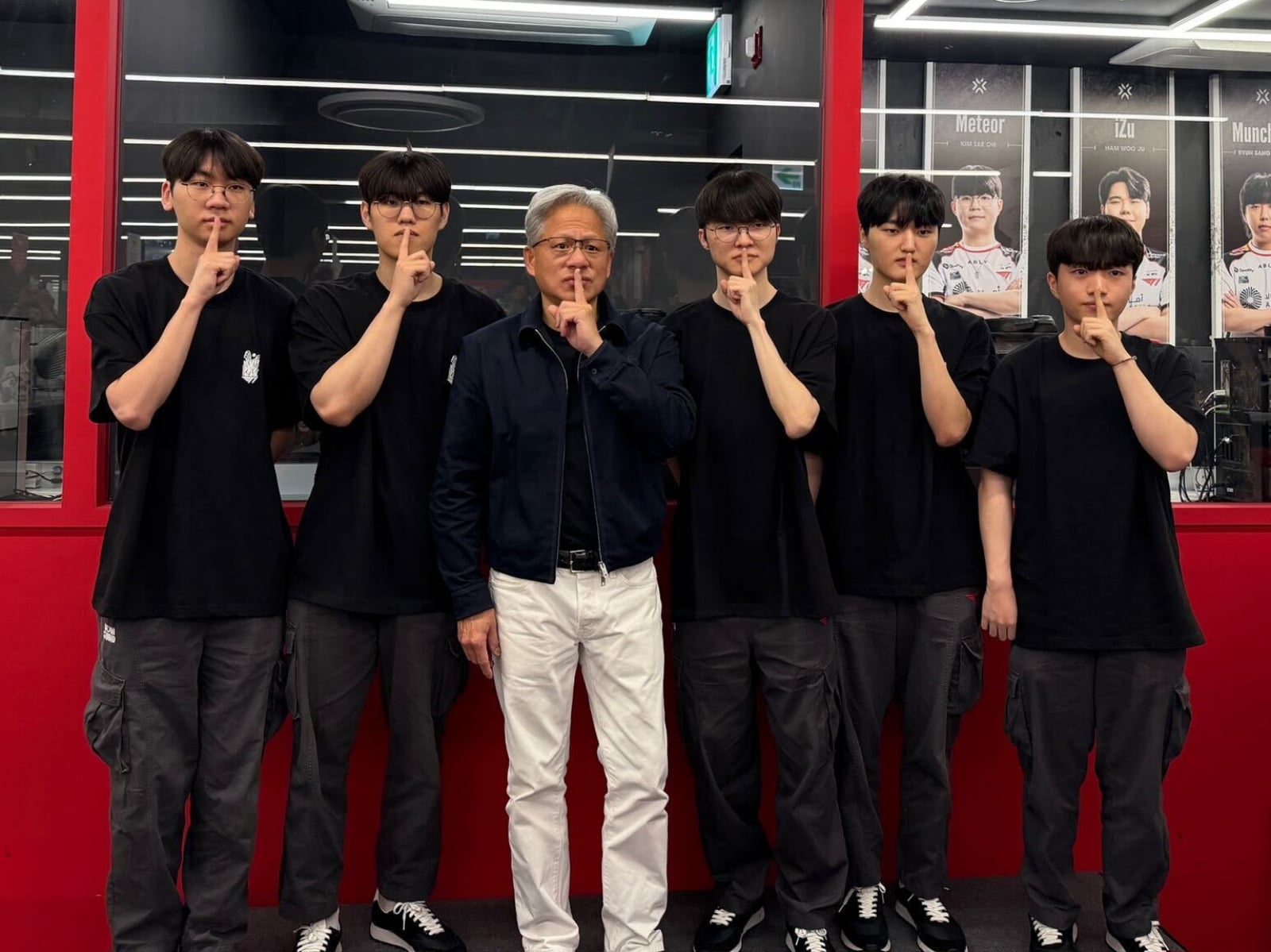

結束台北國際電腦展(Computex)的密集行程後,輝達(NVIDIA)執行長黃仁勳於2026年6月5日搭乘私人飛機旋風式抵達首爾金浦機場,時隔7個月再度踏上韓國土地。一落地,他沒有直奔財閥總部或電視台錄影棚,而是把第一個行程留給了電競—— ...2026-06-05 更新

-

輝達(NVIDIA)執行長黃仁勳於 GTC Taipei 大會公開展示 AI 供應鏈合作夥伴名單,其中台灣工業電腦大廠凌華科技(ADLINK)名列其中,引發市場高度關注。然而,這份名單意外掀起的討論焦點卻不只停留在科技產業。隨著網友挖出韓團 ...2026-06-05

-

輝達(NVIDIA)執行長黃仁勳日前出席 GTC Taipei 大會演講時,身後背板公開多家台灣 AI 供應鏈合作夥伴名單,其中邊緣運算大廠凌華科技(ADLINK,股票代號:6166)也名列其中。消息曝光後,不僅引發科技圈討論,更意外在 N ...2026-06-04

-

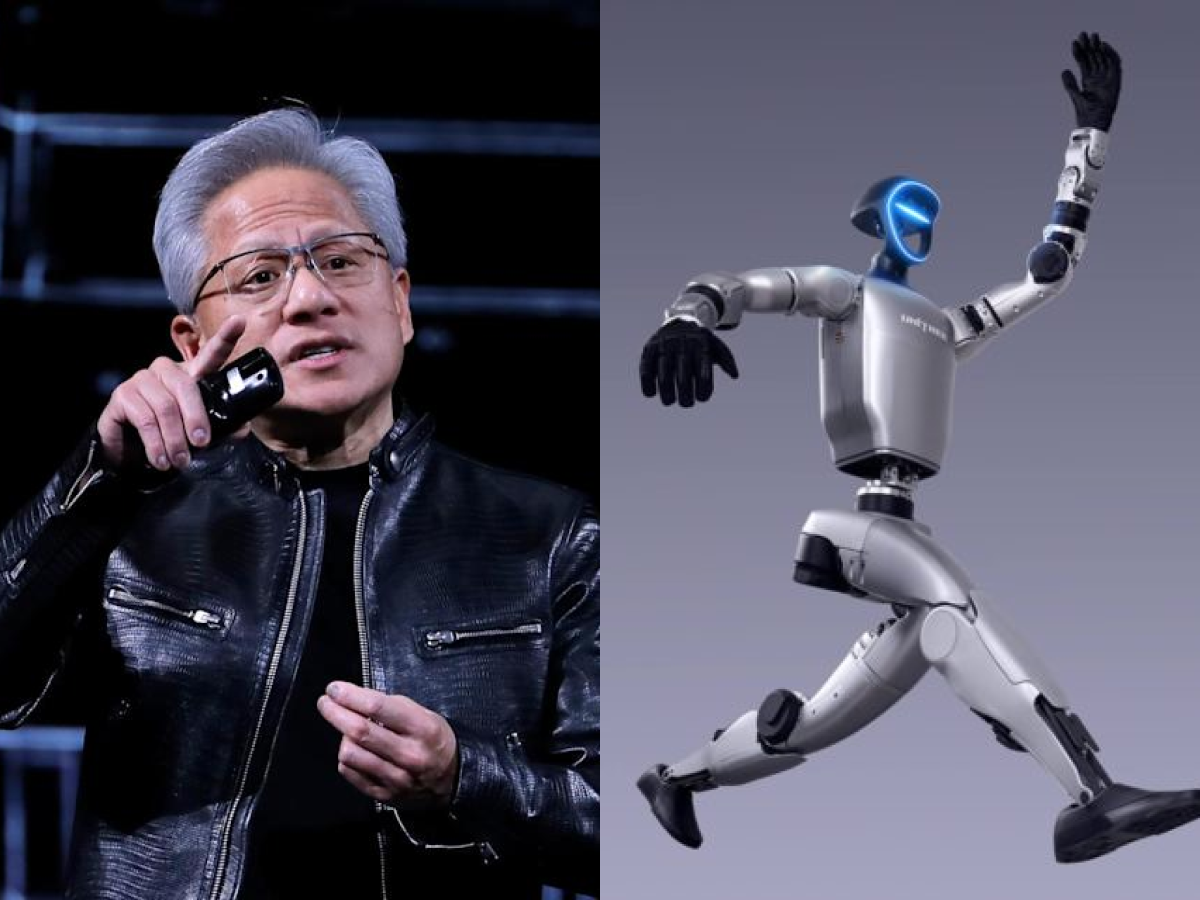

中國機器人新創企業宇樹科技(Unitree Robotics)近期接連引發關注。先是科創板 IPO 申請從受理到通過上市委審議僅花 73 天,刷新今年科創板 IPO 審核速度紀錄,有望成為 A 股市場「人形機器人第一股」;接著 NVIDIA ...2026-06-04 更新

-

輝達執行長黃仁勳 COMPUTEX 期間二度造訪饒河夜市,這次隨行的是美國頂級科技播客萊克斯弗里德曼(Lex Fridman)。兩人同框吃芒果冰的合照一曝光立刻引爆科技迷,弗里德曼直言黃仁勳在台灣被當作搖滾巨星接待,「就像 60 年代的披頭 ...2026-06-04